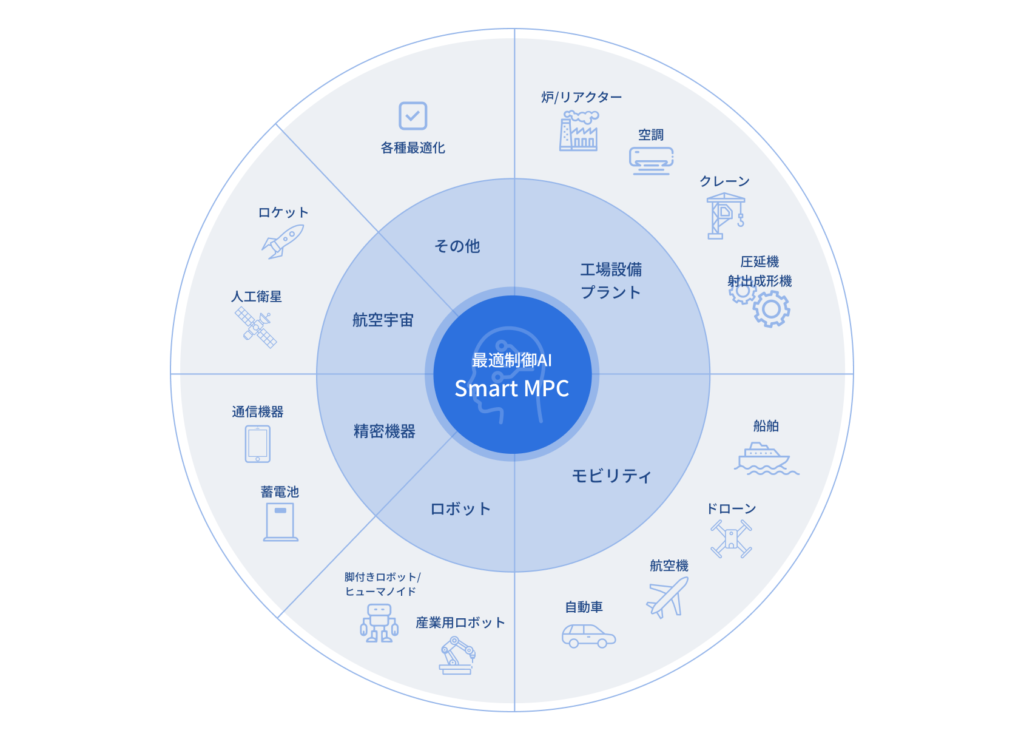

E-Smart MPC

AI制御 ー PID制御より賢く、強化学習より実用的

E-Smart MPCの製品仕様

ハードウェア仕様

・プロセッサ:Cortex A76(4コア)

・メモリ:8GB RAM

・ストレージ:eMMC 32GB+SSD 128GB~1TB

・筐体:制御盤収納対応(産業用規格準拠)

・電源:DC24V(産業標準)

・動作温度:-20〜60℃

・ネットワーク:Gigabit Ethernet × 2ポート

・通信プロトコル:MCプロトコル等 対応

ソフトウェア仕様

Smart MPCエンジン

・独自開発の高速MPC演算アルゴリズム

・リアルタイム学習・推論エンジン

・自動パラメータ調整機能

システム要件

・各社主要PLCに対応

・Grafana連携による可視化・入力が可能

導入例

Smart MPC®の導入

今回、トリニティ工業株式会社様の「T.E.G.A.」のコントローラーとして、弊社の最適制御AI Smart MPC®を新たに導入しました。

「Smart MPC®」と「T.E.G.A.」が融合した、全く新しい塗装プラント向け空調制御システムを共同開発することに成功しました。

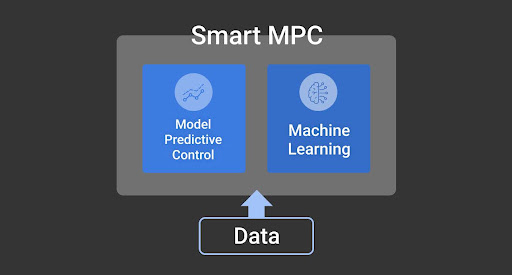

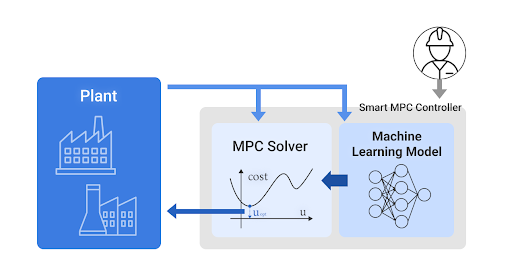

Smart MPC®は機械学習とMPC(モデル予測制御)を組み合わせた技術で、MPCのモデリングの難しさをデータドリブン方法で解決します。

当技術はMPCの特性を引き継いでいて、以下のようなメリットがあります。

・多入力多出力(MIMO)系に対応可能

・むだ時間に強く、ハンチングを起こしにくい

・拘束条件を扱える

・エネルギーなどの最適化が可能

さらに、以下のような特徴があります:

・機械学習による自動モデリング

・少ないデータでも適用可能な実用性

・オンライン学習による環境変化への適応能力

これらが実機への適用可能性を高めています。

Smart MPC®による改善

Smart MPC®による最適制御の動作については、空調とは異なりますが、炉の温度制御を模したデモの以下の動画で、御確認願います。

Smart MPC®の導入によって空調機の制御性能は以下のように改善しました:

・送気温度精度:±1℃ → ±0.2℃

・送気湿度精度:±5% → ±2%

・エネルギー消費量:5%削減(最大で年間300万円相当)

※空調機仕様、構成、稼働時間、原動力単価等により異なります。

まとめ

安定性の向上に加え、T.E.G.A.による省エネ制御にSmart MPC®の動的なエネルギー最適制御が加わることで、より大幅な省エネ化とCO2排出量の削減に成功しました。今後もさらなる性能向上を目指し、Smart MPC®の改良を継続してまいります。